国産AIの新たな旗手!アイリスが「Fast-Math」を世界へ公開

AI(人工知能)技術の進化は目覚ましく、私たちの生活やビジネスに大きな変革をもたらしています。そんな中、日本のAI技術が世界に誇る新たな一歩を踏み出しました。アイリス株式会社は、Googleが運営する世界最大のAIコンペティションプラットフォーム「Kaggle」の「AI Mathematical Olympiad – Progress Prize 2(AI数学オリンピック)」で金メダルを獲得した同社エンジニアが構築した、革新的なAI基盤モデル「Fast-Math」を公開しました。

この「Fast-Math」は、ただ高性能なだけでなく、AIの正確さを保ちつつ、従来モデルに比べて非常に少ない計算量で動作するという、画期的な効率性を兼ね備えています。AI開発における大きな課題である「計算資源(GPUなどの高性能なコンピューター部品)」や「電力消費」の問題に対し、具体的な解決策を提示する国産AIとして、今、大きな注目を集めています。

「Fast-Math」とは?なぜ今、注目されるのか

「Fast-Math」は、アイリスのエンジニアがオープンソースの大規模言語モデル(LLM)であるAlibabaの「Qwen3」などを基に開発した、独自のAI基盤モデルです。ここでいう「基盤モデル」とは、さまざまなタスクに応用できる、AIの土台となる非常に大きなモデルのことを指します。ChatGPTのような生成AIも、この基盤モデルの一種です。

世界トップクラスの正確性と計算効率を両立

「Fast-Math」が特に優れている点は、その「正確性」と「計算効率」を高いレベルで両立していることです。AIの性能を測る上で、問題に対する「正確さ」はもちろん重要ですが、それと同時に、AIが答えを出すまでの「計算にかかる時間や電力」も非常に重要になってきます。

最近のAIは非常に複雑で大規模なため、動かすには膨大な計算資源と電力が必要になります。例えば、米国の主要なテクノロジー企業では、AI開発のためだけに原子力発電所数十基分もの電力が必要になるという試算もあるほどです。このような状況では、地球環境への配慮や、安定したインフラの維持という観点からも、「計算効率」の向上が人類全体にとって解決すべき大きな課題となっています。「Fast-Math」は、この課題に対し、明確な答えを提示するモデルとして開発されました。

国産AIの重要性「ソブリンAI」

近年、AIは単なる技術の枠を超え、国家の経済安全保障にも関わる重要な要素として認識されるようになりました。特に、「ソブリンAI」という言葉が注目されています。これは、「外国企業の管理下にない、自国で開発・管理されたAI基盤モデル」を意味します。

なぜソブリンAIが重要なのでしょうか?それは、AIが社会の様々なインフラや意思決定に深く関わるようになるにつれて、そのAIがどのような思想やデータに基づいて学習され、どのように動作するかが、国の安全保障や経済活動に直結するからです。外国製のAIに全面的に依存することは、技術的な自立性やデータのプライバシー、さらには緊急時の対応能力といった面でリスクを伴う可能性があります。

日本政府もこの重要性を認識しており、経済産業省が推進する生成AIの開発力強化に向けたプログラム「GENIAC」などで、国産基盤モデルの開発を支援しています。詳細は以下の資料で確認できます。

「Fast-Math」のような国産AIの登場は、日本のAI技術の自立性を高め、国際競争力を強化する上で非常に重要な意味を持ちます。

Fast-Mathの驚くべき性能と技術的背景

アイリスのAIエンジニアである吉原浩之氏のコメントから、「Fast-Math」の具体的な性能と、それを実現した技術的な工夫について詳しく見ていきましょう。

吉原氏によると、「Fast-Math」は、高度な思考能力を持つAIモデルとして知られる「DeepSeek-R1」から着想を得て開発されたモデルファミリーの一つです。開発には、「教師あり学習」と「強化学習」という二つの異なるAI学習方法が組み合わされました。

-

教師あり学習: 正解が与えられたデータ(例: 数学の問題と正しい答え)を使ってAIを学習させる方法です。これにより、AIは基本的な知識や推論のパターンを習得します。

-

強化学習: AIが自分で試行錯誤し、良い結果を出したら「報酬」を与え、悪い結果を出したら「罰」を与えることで、より良い行動を学習させる方法です。これにより、AIはより複雑な問題解決能力や、効率的な推論方法を身につけます。

これらの学習方法を、数学オリンピック国内大会レベルの非常に難しい問題に適用することで、「Fast-Math」はベースとなるモデルの精度を維持しながら、最大で約65%もの推論高速化を実現しました。推論速度が速くなるということは、AIが答えを出すまでの時間が短縮され、同じ時間でより多くの問題を処理できることを意味します。

主要ベンチマークでのトップクラスの性能

特に注目すべきは、「Fast-Math-Qwen3-14B」というモデルの性能です。これは、AIME(American Invitational Mathematics Examination)やMATH500といった、AIの数学能力を測る主要なベンチマーク(性能評価試験)において、トークン(言語処理の最小単位)あたりの精度で、同じ規模のLLM(大規模言語モデル)の中でトップクラスの性能を達成しています。これは、AIが言葉の最小単位から正確に理解し、高度な数学的推論を行える能力が高いことを示しています。

精度と計算効率のバランス

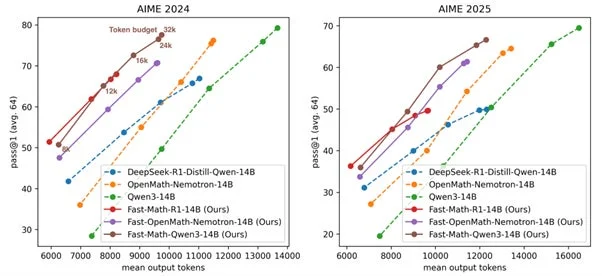

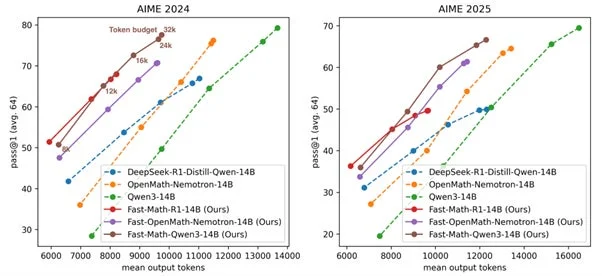

以下のグラフは、「Fast-Math」モデルファミリーが、既存モデルと比較して、いかに優れた効率性を持っているかを示しています。

このグラフでは、縦軸が「精度」、横軸が「計算効率(トークン消費量)」を表しています。グラフの上方にあるほど精度が高く、左方にあるほど効率が高いことを意味します。実線で示されている「Fast-Math」モデルファミリーは、破線で示された既存モデルと比較して、計算効率の面で大幅な改善を見せていることが一目瞭然です。これは、「Fast-Math」が、高い精度を維持しつつ、より少ない計算資源と電力で動作できることを明確に示しています。

オープンソースとしての公開と今後の展望

アイリスは、「Fast-Math」モデル、そのソースコード、そして学習に使用したデータセットを、全て商用利用可能なライセンス(CC BY 4.0 ライセンス)でHugging Face上で公開しています。Hugging Faceは、AIモデルやデータセットを共有するためのプラットフォームであり、世界中の研究者や開発者がアクセスできます。

これにより、誰でも「Fast-Math」の技術を利用し、さらに発展させることが可能になります。オープンソースとして公開することで、AI技術の発展が加速し、より多くの人々がその恩恵を受けられるようになるでしょう。

さらに、このプロジェクトで得られた知見は、国際学会ICML 2025の「2nd AI for Math Workshop」にて発表されました。研究論文は以下のリンクから参照できます。

アイリス株式会社は、AI製品の開発だけでなく、機械学習技術そのものの研究開発にも力を入れています。今回の「Fast-Math」の公開は、同社の研究開発力の高さを示すものであり、今後のさらなる技術革新に期待が寄せられます。

アイリス株式会社について

アイリス株式会社は、「みんなで共創できる、ひらかれた医療をつくる。」というミッションを掲げ、2017年に創業しました。現役医師である代表の沖山翔氏をはじめ、医療従事者、厚生労働省や経済産業省などの行政出身者、AI医療領域に特化したデータサイエンティスト、大手医療機器メーカー出身者など、多岐にわたる専門家が集結しています。

同社は、深層学習技術(AI技術)を活用し、医師が持つ熟練の技をデジタル化するAI医療機器の開発に取り組んでいます。AI医療機器は、診断の精度向上や医師の負担軽減など、医療現場に大きなメリットをもたらすことが期待されています。「Fast-Math」で培われた効率的なAI技術は、医療分野においても、より迅速で正確な診断支援システムの実現に貢献するでしょう。

まとめ:国産AI「Fast-Math」が切り拓く未来

アイリス株式会社が公開した国産AI基盤モデル「Fast-Math」は、世界大会で入賞したエンジニアの技術と、高い正確性、そして革新的な計算効率を兼ね備えた、まさに次世代のAIモデルです。AI開発における電力消費や計算資源の課題解決に貢献し、国家の経済安全保障にも寄与する「ソブリンAI」としての重要性も担っています。

オープンソースとして公開されたことで、その技術は世界中で活用され、さらなるイノベーションを加速させることでしょう。アイリスのAI医療機器開発と、機械学習技術の研究開発への継続的な取り組みは、私たちの社会、特に医療分野において、より良い未来を築くための重要な礎となるはずです。今後のアイリスの動向に、引き続き注目していきましょう。