リコーが「GENIAC」で革新的なマルチモーダルAIを開発!企業ドキュメントを深く理解する「リーズニングLMM」とは?軽量モデルは無償公開

株式会社リコーは、経済産業省と国立研究開発法人新エネルギー・産業技術総合開発機構(NEDO)が推進する、国内の生成AI開発力強化プロジェクト「GENIAC(Generative AI Accelerator Challenge)」の第3期において、画期的なマルチモーダル大規模言語モデル(LMM)を開発しました。この新しいモデルは、複雑な図表を含む企業ドキュメントを、まるで人間のように深く理解し、多段階の思考プロセスを経て正確に読み解く「リーズニング性能」を備えている点が大きな特徴です。

本記事では、リコーが開発したこの「リーズニングLMM」がどのようなAIなのか、なぜ今、企業にとってこのようなAIが必要とされているのか、そして本日より無償公開される軽量モデルの活用方法まで、AI初心者の方にも分かりやすく、詳しく解説していきます。

マルチモーダル大規模言語モデル(LMM)とは?

まず、今回の主役である「マルチモーダル大規模言語モデル(LMM)」について、簡単に説明しましょう。

「LMM」とは、「Large Multimodal Model」の略で、テキスト(文章)だけでなく、画像、音声、動画といった複数の種類のデータを同時に処理できるAI技術のことです。これまでの多くのAIは、テキストだけ、画像だけ、といった単一のデータ形式に特化していました。しかし、LMMはこれらをまとめて理解できるため、例えば「スマートフォンのスクリーンショットから要約を作成する」とか、「グラフや表を含む資料について質問に答える」といった、より複雑で現実的なタスクに対応できます。

企業で使われるドキュメントは、文字だけでなく、図やグラフ、写真など、さまざまな情報が組み合わさってできています。そのため、LMMは企業内の膨大なドキュメントを効率的に活用し、新たな価値を生み出すためのAIとして、大きな期待が寄せられています。

リコーが開発した「リーズニングLMM」の画期性

リコーがGENIAC第3期で開発を完了したのは、基本モデル「Qwen3-VL-Ricoh-32B-20260227」と呼ばれるリーズニングLMMです。このモデルの最大の特長は、単にドキュメントの内容を読み取るだけでなく、「リーズニング性能」、つまり論理的な推論能力を備えている点にあります。

リーズニング性能とは?

「リーズニング性能」とは、AIが情報を単に検索したり、テキストを生成したりするだけでなく、複数のステップを踏んだ論理的な思考プロセスを経て結論を導き出す能力を指します。人間が複雑な問題を解決する際に、様々な情報を統合し、段階的に考えて答えを出すのと同じようなイメージです。

企業ドキュメント、特に経営資料や技術マニュアル、品質管理基準などには、複数のページにわたる複雑な図表や、数値に基づく計算、比較分析が必要な情報が多く含まれています。従来のAIでは、これらの複雑な情報を正確に読み解き、論理的な結論を導き出すことは困難でした。しかし、リコーのリーズニングLMMは、多段推論という手法を用いることで、こうした難解なドキュメントも高精度に理解し、質問に対して適切な回答を生成できるようになりました。

強化学習とカリキュラム学習による性能向上

今回のモデル開発では、AIの学習方法にも工夫が凝らされています。具体的には、「強化学習」と「カリキュラム学習」という手法が適用されました。

-

強化学習: AIが環境と相互作用しながら最適な行動を学習する方法です。リコーは独自の報酬関数を設定することで、学習効率を高めつつ、AIが特定の情報に偏りすぎる「過学習」を抑制することに成功しました。

-

カリキュラム学習: AIに学習させる情報の順序を工夫する学習方法です。人間が簡単なことから学び、徐々に難しい内容に進むように、AIも難易度設定と学習ペースを最適化することで、効率的かつ効果的に学習を進めました。

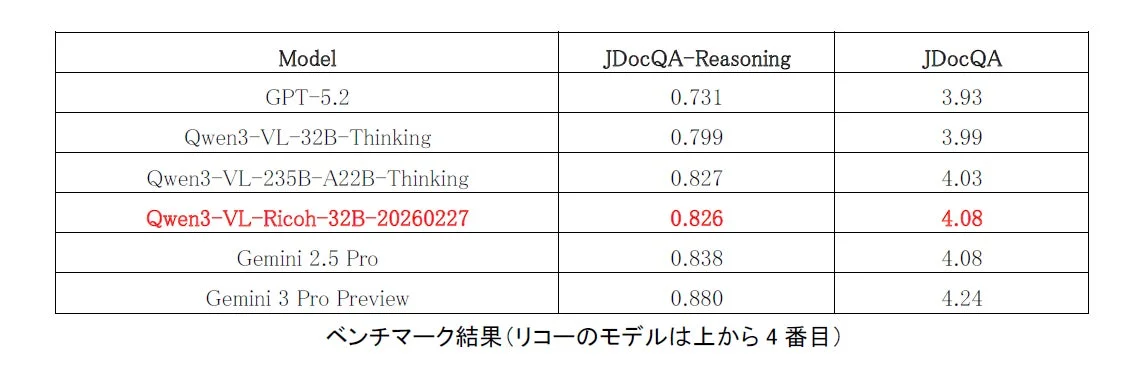

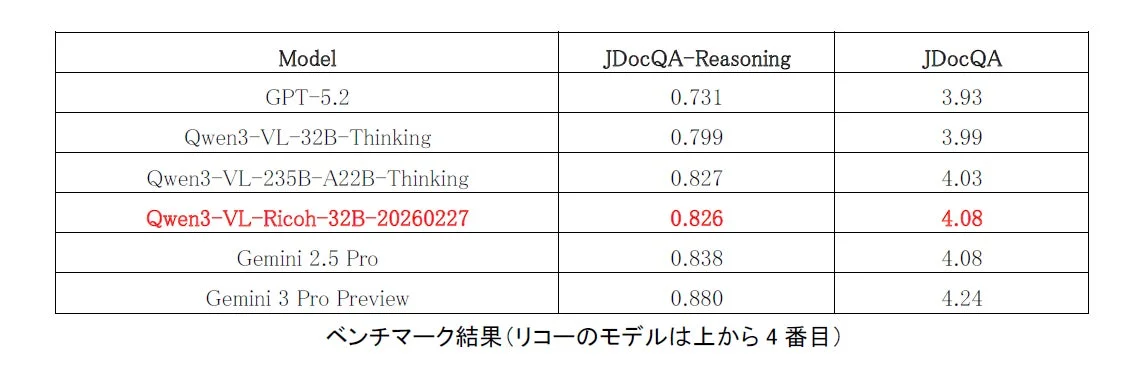

これらの学習手法の組み合わせにより、リコーのリーズニングLMMは、複数ページにまたがる図表を関連付けて理解したり、読解難易度の高い質問にも高精度で回答したりする能力を獲得しました。その性能は、2026年2月17日時点の評価で、「Gemini2.5-Pro」などの大型商用モデルと同等のベンチマーク結果を確認しているとのことです。

AIモデルのJDocQAベンチマーク結果を示す表。GPT、Qwen3、GeminiなどのモデルがJDocQA-ReasoningとJDocQAのスコアで比較されており、リコーのモデルの性能が強調されている。

複数のAIモデル(LMM/LLM)が「公開ベンチマーク (JDocQA)」と「独自ベンチマーク (JDocQA-Reasoning)」の2つの評価基準でどのように性能を発揮するかを比較した散布図。特に「リコーLMM-32B」が公開ベンチマークで高いスコアを示していることが強調されている。

日本語での思考プロセスに対応し、信頼性を向上

さらに、日本企業での実務利用を想定し、AIの思考プロセスを日本語化する取り組みも行われました。これにより、日本語の文書をより正確に読み取れるだけでなく、AIが回答を導き出す際の判断根拠や前提条件を日本語で確認できるようになりました。これは、ビジネスの現場でAIを利用する上で、その回答の信頼性を高める上で非常に重要なポイントです。

本日より無償公開!軽量モデル「Qwen3-VL-Ricoh-8B-20260227」

リコーは、今回開発した基本モデルの技術を活用した軽量モデル「Qwen3-VL-Ricoh-8B-20260227」を本日より無償公開しています。

この軽量モデルは、より少ない計算リソースで動作するため、多くの企業や開発者が手軽にAIを活用できる機会を提供します。

【公開先】

https://huggingface.co/ricoh-ai/Qwen-3-VL-Ricoh-8B-20260227

また、リーズニング性能の評価に特化したリコー独自開発のベンチマークツールも、今後公開される予定です。これにより、AI開発コミュニティ全体でのLMMの進化に貢献することが期待されます。

なぜ今、企業ドキュメントのAI活用が求められるのか?

企業には、日々膨大な量のドキュメントが蓄積されています。請求書や領収書のような取引データから、事業戦略や経営計画、さらにはサービスマニュアルや技術標準、品質管理基準といった専門的な資料まで、その種類は多岐にわたります。これらのドキュメントには、企業の貴重な知識やノウハウが詰まっていますが、「テキスト検索だけでは必要な情報が見つからない」「検索機能だけでは文書を十分に活用できない」といった課題が長年指摘されてきました。

さらに近年では、少子高齢化による労働力人口の減少、ベテラン社員の退職に伴う技能やノウハウの伝承の難しさ、外国人労働者の増加に伴う文書の多言語化ニーズなど、多くの経営課題に直面しています。こうした背景から、AIを活用して企業内の知識を効率的に引き出し、活用するニーズがかつてないほど高まっています。

リコーのリーズニングLMMは、まさにこれらの課題を解決するために開発されました。テキストと図表が混在する複雑なドキュメントから、AIが論理的に情報を読み解くことで、企業の知識活用を大きく前進させることが期待されます。

リコーのGENIACにおけるこれまでの取り組み

リコーは、GENIACプロジェクトに積極的に参加し、AI技術の発展に貢献してきました。

2024年8月から実施されたGENIAC第2期では、700億パラメータのLMMを開発し、その基本モデルと独自開発のベンチマークツールを無償公開しています。

また、2026年1月には、中国のアリババクラウドが開発・提供するLLMファミリー「Qwen2.5-VL-32B-Instruct」をベースにした、320億パラメータのコンパクトなLMMも開発しました。

今回の第3期でのリーズニングLMMの開発は、これらの実績の上に成り立つものであり、リコーのAI開発における着実な進歩を示しています。

企業での活用に向けた具体的なメリット

リコーが開発したリーズニングLMMは、企業での具体的な活用を強く意識して設計されています。

1. セキュリティとプライバシーを重視したオンプレミス導入

多くの企業は、AIを利用する際にセキュリティ、プライバシー、ガバナンスの観点から、自社データセンターや社内専用環境(オンプレミス)での利用を望んでいます。リコーのモデルは、このようなオンプレミス環境への導入が可能であり、企業は自社のデータを外部に出すことなく、安全にAIを活用できます。また、企業の業種や業務内容に合わせて、AIをさらに賢くする「ファインチューニング」にも対応しているため、より自社のニーズに合ったAIを構築することが可能です。

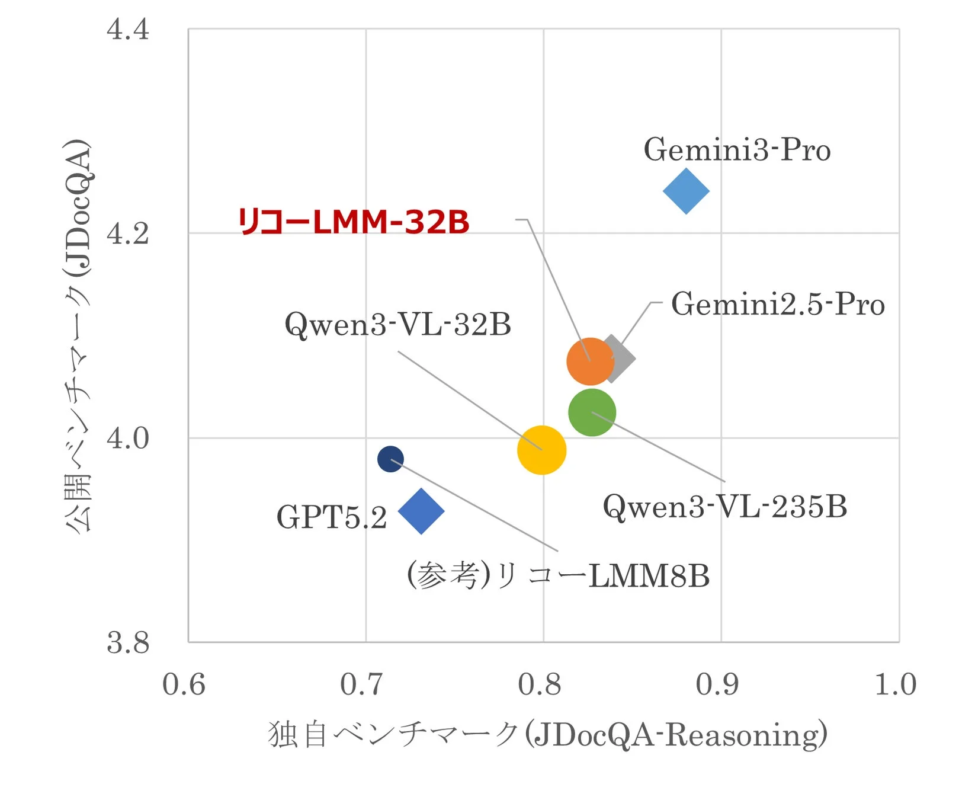

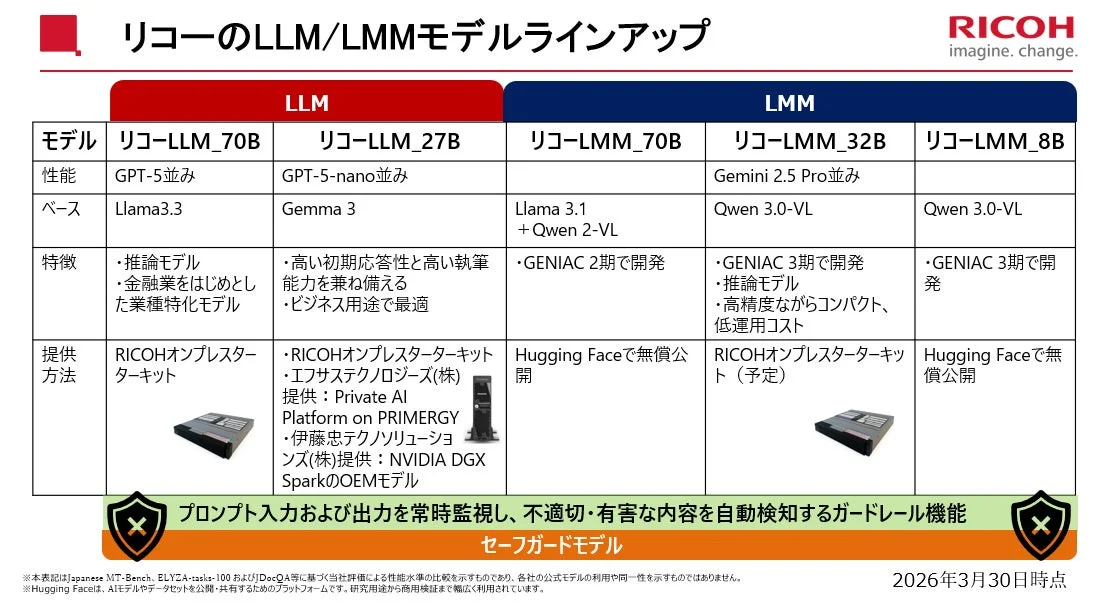

リコーのLLM/LMMモデルラインアップを解説。GPT-5並みのLLMやGemini 2.5 Pro並みのLMMなど、性能や用途に応じたモデルが提供され、オンプレミスやHugging Faceで利用可能。不適切コンテンツを検知するセーフガードモデルも搭載。

2. コスト低減と効率的な開発

AIモデルの開発や運用には、高額なコストがかかることが課題とされています。リコーは、この課題に対し、「モデルマージ技術」と「独自の画像トークン圧縮技術」で対応しています。

-

モデルマージ技術: 複数の学習済みLLMモデルを組み合わせて、より高性能なモデルを作る新しい技術です。これにより、大規模な計算リソース(GPUなど)がなくても効率的にモデル開発が可能となり、開発コストの低減に貢献します。

-

独自の画像トークン圧縮技術: LMMはテキストや図表のデータを「トークン」と呼ばれる符号に変換して処理しますが、リコーはこの画像トークンを効率的に圧縮する技術を開発しました。これにより、AIの高性能化に伴い増大しがちな運用コストを低減できます。

これらの技術は、企業がAIを導入・運用する際の費用を抑え、より多くの企業がAIを活用できる環境を整えることを目指しています。

詳細な技術情報は、リコーの技術ページで確認できます。

https://jp.ricoh.com/technology/ai/LLM#20260330

3. 製造業における具体的な適用例

リコーは、今回のモデルの具体的な適用例として、製造業のお客様からのニーズを挙げています。

-

トラブル発生時の早期解決: 社内ドキュメントを高精度に参照することで、過去の事例や技術情報を素早く見つけ出し、トラブルの早期解決につなげます。

-

製品開発段階での適合確認: 設計図と要求仕様をAIが比較・分析し、適合性を確認することで、開発プロセスの効率化と品質向上に貢献します。

これらの適用例は、今後実証実験を進めていく予定であり、製造業におけるAI活用の可能性を大きく広げることでしょう。

リコーのAI開発の歴史と今後の展望

リコーは、1980年代にAI開発を開始して以来、長年にわたりAI技術の研究開発に取り組んできました。特に、複合機やスキャナー、カメラなどのエッジデバイス開発で培った画像処理技術と、ドキュメントおよびワークフロー管理に関する豊富な知見を活かした「ドキュメントAI」の開発に強みを持っています。

企業の「暗黙知」をAIで活用する「Hi.DEEN」

2025年12月には、企業内に蓄積された、言語化されていない「暗黙知」を含む情報資産をAIで利活用するための企業向けAIプラットフォーム「Hi.DEEN(ヒデン)」を発表しました。これは、文書データだけでなく、社員の経験やノウハウといった見えにくい知識もAIで引き出し、企業の競争力に変えることを目指すものです。

AX(AIトランスフォーメーション)実現に向けた取り組み

2026年3月には、AI・デジタル技術を軸にコンサルティング事業を展開する株式会社ライズ・コンサルティング・グループと、企業の経営課題解決を目的としたAX(AIトランスフォーメーション)の実現を支援する合弁会社設立に向けた基本合意書を締結しています。これは、AI技術の開発だけでなく、それを企業に導入し、ビジネス変革を支援する体制も強化していることを示しています。

リコーは、これらの取り組みに加え、GENIACで得られた成果を広く社会に還元することで、日本企業の「知の結晶」ともいえるドキュメントの利活用を促進していくとしています。これにより、業務革新と付加価値の高い働き方を支援し、企業価値の向上に貢献していく方針です。

まとめ:リコーのリーズニングLMMが拓く未来

今回のリコーによるリーズニング性能を備えたマルチモーダル大規模言語モデルの開発と無償公開は、AI技術の進化において重要な一歩です。特に、複雑な図表を含む企業ドキュメントの読解に対応し、多段推論によって深い理解を可能にするこの技術は、企業が抱える情報活用の課題に対し、強力な解決策を提供します。

軽量モデルの無償公開は、より多くの企業や開発者がこの先進的なAI技術に触れ、それぞれのビジネスシーンで活用を試す機会を生み出すことでしょう。セキュリティを重視したオンプレミス導入への対応や、開発・運用コストの低減への取り組みは、企業がAIを安心して、かつ持続的に利用するための基盤を築きます。

リコーは、長年のAI開発の知見とドキュメントに関する専門性を活かし、これからも「はたらく」現場の変革を支援し、持続可能な社会の実現に貢献していくことが期待されます。企業のドキュメントが持つ潜在能力を最大限に引き出し、新たな価値創造へとつなげるリコーのAI技術の今後の展開に注目が集まります。

関連リンク

-

リコーのAI開発の最前線:企業のAI活用を広げる「マルチモーダルLLM」

https://jp.ricoh.com/news/stories/articles/multimodal-llm -

Hugging Face:「Qwen3-VL-Ricoh-8B-20260227」を公開

https://huggingface.co/ricoh-ai/Qwen-3-VL-Ricoh-8B-20260227 -

リコーのLLM/LMMモデルラインアップ

https://jp.ricoh.com/technology/ai/LLM -

リコーとライズ・コンサルティング・グループ、AX実現を支援する合弁会社設立に向け基本合意

https://jp.ricoh.com/release/2026/0303_1 -

年間の研究成果をまとめた「リコー テクニカルレポートNo48」発行

https://jp.ricoh.com/info/2026/0318_1 -

リコーグループについて

https://jp.ricoh.com/