【505名調査】生成AIの「ハルシネーション」は企業の重要課題!RAG導入で信頼できるAI活用を実現する方法とは?

近年、ChatGPTをはじめとする生成AIの進化は目覚ましく、ビジネスの現場でもその活用が急速に広がっています。しかし、その恩恵を享受する一方で、AIが「もっともらしい嘘」をつく現象、通称「ハルシネーション(幻覚)」が企業にとって看過できないリスクとして浮上しています。

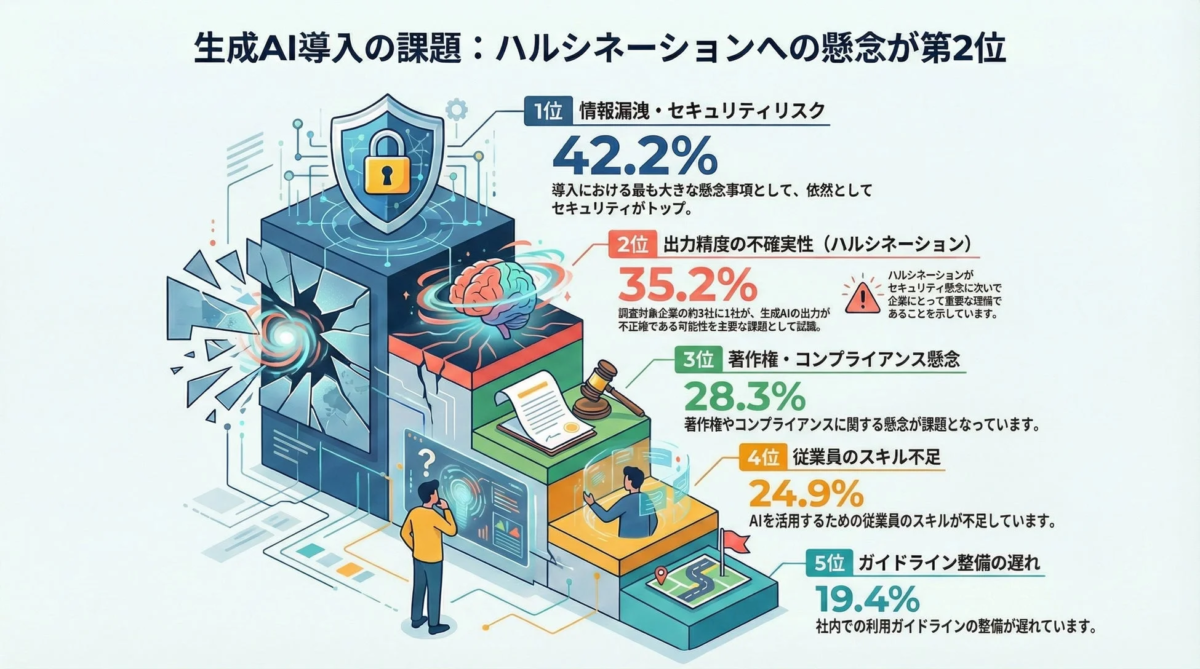

ラーゲイト株式会社が2025年12月に実施した最新の調査では、505名の情報システム部門・DX推進室所属のビジネスパーソンを対象に、生成AI活用における出力精度とハルシネーションの実態が明らかになりました。この調査結果から、35.2%もの企業がハルシネーションを課題と認識しており、情報漏洩やセキュリティリスクに次ぐ第2位の懸念事項であることが判明しました。

本記事では、この調査結果を深掘りしつつ、AI初心者の方にもわかりやすい言葉でハルシネーションの正体と、その最も効果的な対策である「RAG(検索拡張生成)」について詳しく解説します。企業が生成AIを安全かつ効果的に活用するためのヒントを探っていきましょう。

生成AIの「ハルシネーション」とは? なぜ発生するのか

「ハルシネーション」とは、生成AIが事実に基づかない情報を、あたかも正確であるかのように自信満々に提示する現象を指します。例えば、存在しない人物の名前を挙げたり、架空の統計データを事実として述べたり、過去の情報を最新のものとして提示したりすることがあります。まるでAIが「幻覚を見ている」かのように、根拠のない情報を生成してしまうのです。

では、なぜこのような現象が起こるのでしょうか?その背景には、生成AI、特に大規模言語モデル(LLM)の基本的な設計思想があります。

大規模言語モデル(LLM)は、インターネット上の膨大なテキストデータを学習することで、人間が話すような自然な文章を生成する能力を獲得します。しかし、その目的は「もっともらしい文章を生成すること」であり、「常に正確な情報を出力すること」は本質的に保証されていません。まるで作文が得意な生徒が、事実確認をせずに想像で文章を書き上げてしまうようなものです。

ハルシネーションが発生する主な理由はいくつか考えられます。

-

学習データの限界: AIが学習したデータに誤りが含まれていたり、最新の情報が反映されていなかったりする場合、その誤りや古い情報に基づいて回答してしまうことがあります。

-

文脈理解の制約: 複雑な質問や曖昧な指示に対して、AIが文脈を完全に理解できず、誤った推測に基づいて回答を生成することがあります。

-

創造性の副作用: AIは与えられた情報から新しい情報を「創造」する能力も持っています。この創造性が、時には事実ではない情報を生み出す原因となることがあります。

-

内部的な矛盾: 学習データ内の矛盾や、モデル自体の内部的なバイアスが原因で、一貫性のない、あるいは誤った情報を出力することがあります。

これらの特性が組み合わさることで、ビジネスにおける意思決定の材料として生成AIを活用する際に、ハルシネーションは深刻なリスクとなり得ます。誤った情報に基づいた判断は、ビジネスに直接的な損失をもたらす可能性も否定できません。

505名調査で判明!ハルシネーションはセキュリティに次ぐ重要課題に

ラーゲイト株式会社が実施した「生成AI活用における出力精度・ハルシネーション実態調査」では、企業が生成AI導入に際してどのような課題を抱えているかが明確になりました。

調査結果のハイライトは以下の通りです。

-

35.2%の企業がハルシネーションを課題と認識: 生成AI導入における課題として、「出力精度の不確実性(ハルシネーション)」を挙げた企業は35.2%に達しました。これは「情報漏洩・セキュリティリスク」(42.2%)に次ぐ第2位であり、約3社に1社がハルシネーションを重要な経営課題として捉えていることが明らかになりました。

-

「情報収集・分析」領域が最高リスク: 業務領域別にハルシネーションのリスクを分析したところ、「情報収集・調査・分析」での活用率が39.2%と最も高く、そのリスク・影響度も「高」と評価されました。誤った市場データや競合情報に基づく意思決定は、ビジネスに直接的な損害をもたらす可能性があり、特に注意が必要です。

その他、「システム開発・運用」(活用率37.4%)では、AIが生成したコードにバグや脆弱性が混入するリスクが指摘されており、人間による厳密なコードレビューが不可欠とされています。一方、「議事録作成・要約」(活用率28.1%)は元の音声や文書が存在するため、比較的リスクは低いものの、情報の取捨選択に偏りが生じる可能性が示唆されています。

この調査結果は、ハルシネーションが単なる「使い方の問題」ではなく、組織全体で取り組むべきガバナンス上の課題であることを明確に示しています。生成AIの活用が進むほど、その出力品質の管理はIT部門だけでなく、経営層が重視すべきテーマとなるでしょう。

ハルシネーション対策の最重要手法「RAG(検索拡張生成)」とは?

ハルシネーションを完全にゼロにすることは難しいとされていますが、その発生を大幅に低減し、信頼性を高めるための最も効果的な手法として注目されているのが「RAG(Retrieval-Augmented Generation:検索拡張生成)」です。

RAGの仕組みと有効性

RAGは、大規模言語モデル(LLM)が回答を生成する際に、外部の信頼できる情報源から関連情報を「検索(Retrieval)」し、その情報を基に回答を「生成(Generation)」する技術です。これにより、LLMが学習データのみに依存して回答を生成する際に発生しがちなハルシネーションを抑制し、より事実に基づいた正確な情報を提供できるようになります。

RAGの具体的な仕組みは以下のステップで動作します。

- ユーザーからの質問: ユーザーがAIに対して質問を投げかけます。

- 関連情報の検索: AIシステムは、質問の内容を分析し、企業内のナレッジベース、データベース、ドキュメント、あるいは信頼できる外部の情報源から、質問に関連する情報を検索します。

- 情報と質問の統合: 検索で得られた関連情報とユーザーの元の質問を組み合わせて、大規模言語モデル(LLM)に渡します。

- 回答の生成: LLMは、与えられた関連情報に基づいて回答を生成します。これにより、LLMは「知っていること」だけでなく「参照できる情報」に基づいて回答するため、ハルシネーションのリスクが大幅に低減されます。

このRAGの導入により、LLMの回答を特定の社内ナレッジベースや信頼できる情報源に「制約」できるため、誤情報のリスクを大幅に減らすことが可能になります。特に、企業が持つ機密性の高い情報や最新の社内規定など、LLMの学習データには含まれない情報をAIに参照させたい場合に非常に有効です。

DifyとAmazon Bedrockを活用したノーコードRAG構築

かつてRAG環境の構築は高度なエンジニアリングスキルを要しましたが、現在ではDifyのようなノーコードツールと、Amazon Bedrockのようなクラウドサービスを組み合わせることで、専門知識がなくてもRAG環境を構築できるようになっています。

-

Dify: Difyは、LLMアプリケーションの開発を効率化するためのオープンソースプラットフォームです。RAG機能の構築もサポートしており、ドラッグ&ドロップなどの直感的な操作で、外部データソースとの連携やプロンプトの調整が可能です。これにより、プログラミングの知識がなくても、RAGを活用したAIチャットボットなどを迅速に開発できます。

-

Amazon Bedrock: Amazon Bedrockは、AWS(Amazon Web Services)が提供する生成AIサービスです。様々な基盤モデル(Foundation Models)を利用できるだけでなく、セキュアな環境でAIアプリケーションを運用するための機能を提供します。DifyとAmazon Bedrockを連携させることで、構築したRAGシステムをAWSの堅牢なインフラ上で安全にホスティングし、セキュリティ懸念(調査で1位の課題)も同時に解消する道筋が生まれます。

このように、ノーコードツールとクラウドサービスの組み合わせは、RAG導入のハードルを大きく下げ、「対策の民主化」を後押ししています。

ハルシネーション低減に向けたその他の有効な対策

RAGの導入が最も効果的な対策である一方で、それと合わせて実施することで、さらにハルシネーションのリスクを低減できるアプローチがいくつか存在します。

-

ファクトチェック体制の構築: AIの出力結果を鵜呑みにせず、必ず人間によるファクトチェック(事実確認)を行う体制を構築することが重要です。具体的には、「AI出力 → 自動検証 → 人間レビュー → 修正・承認」といった段階的なプロセスを整備し、誤情報が外部に出ることを防ぎます。

-

プロンプトエンジニアリングの最適化: AIへの指示(プロンプト)を工夫することで、ハルシネーションの発生を抑制できます。例えば、「分からない場合は『分かりません』と回答してください」と明示的に指示したり、「不確かな部分には【要確認】と記載してください」といった制約条件をプロンプトに含めることで、AIが自信満々に誤情報を出力するリスクを低減できます。

-

用途別のモデル選定: 生成AIモデルには、事実確認を重視するもの、コスト効率が高いもの、特定の言語に特化したものなど、様々な種類があります。AIの利用目的や求める精度に応じて最適なモデルを選定することも、品質向上に繋がります。

-

継続的なモニタリングと改善: ハルシネーションの発生率や、ファクトチェックでの修正率といったKPI(重要業績評価指標)を設定し、定期的にモニタリングすることが重要です。これらの指標に基づいて、プロンプトの改善やRAGのデータソースの見直しなど、継続的な改善サイクルを構築することで、AIの信頼性を高めていくことができます。

ラーゲイト株式会社の考察と今後の展望

今回の調査結果が示す重要なメッセージは、ハルシネーションは完全にゼロにはできないものの、適切な対策を講じることで「許容範囲内にコントロールすることは可能」という点です。

35.2%という数字は、生成AIの本格的な業務活用が進む中で顕在化した、ガバナンス上の課題と言えます。生成AIを業務に組み込む企業が増えれば増えるほど、出力品質の管理は単なる「ITの問題」ではなく、「経営の問題」へと昇格します。特に、情報システム部門やDX推進室のように、意思決定の材料として生成AIを頻繁に活用する部署においては、品質管理の仕組みを先行して整備することが、企業の競争優位の源泉となるでしょう。

ラーゲイト株式会社は、RAGとノーコードツールの組み合わせによる「対策の民主化」に注目しています。Difyを活用することで高度なエンジニアリングスキルがなくてもRAG環境を構築でき、さらにAmazon Bedrockとの連携によりAWS上でセキュアにホスティングすることで、企業が抱える上位2大課題であるセキュリティ懸念とハルシネーション懸念を同時に解消する道筋が生まれるとしています。

今後の展望として、企業のAI活用は「使うかどうか」という初期のフェーズから、「品質をいかに担保しながら使うか」という新たなフェーズへ移行すると考えられます。ハルシネーション対策を社内で内製化し、品質管理を徹底できる企業とそうでない企業の間には、意思決定の精度や業務品質において顕著な差が生まれていくでしょう。

ラーゲイト株式会社は、AWS FTR認定取得済みの専門チームが、DifyによるRAG環境構築からAWSセキュアホスティング、社内人材のリスキリングまでを一気通貫で支援しています。RAG導入や信頼性の高いAIチャットボット構築に関する相談を随時受け付けています。

ラーゲイト株式会社の詳細については、以下のリンクをご覧ください。

まとめ:信頼できるAI活用でビジネスを加速する

生成AIの普及は、私たちの働き方やビジネスのあり方を大きく変える可能性を秘めています。しかし、その力を最大限に引き出すためには、ハルシネーションをはじめとするリスクに適切に対処し、AIの出力品質を管理することが不可欠です。

今回の調査結果が示すように、ハルシネーションは多くの企業が認識する重要な課題であり、特に情報収集や分析といった意思決定に直結する領域での対策が求められています。RAGのような先進技術を活用し、ノーコードツールとクラウドサービスを組み合わせることで、これまで専門知識が必要とされたAIの品質管理が、より多くの企業で実現可能になりつつあります。

企業が生成AIを「品質を担保しながら」使いこなすことで、その恩恵を最大限に享受し、競争力をさらに高めることができるでしょう。信頼できるAI活用を通じて、新たなビジネス価値を創造していくことが期待されます。