GMO GPUクラウド、AI開発を飛躍させる最新「NVIDIA HGX B300」をマネージドSlurm環境で提供開始

AI(人工知能)技術の進化は目覚ましく、私たちの生活やビジネスに大きな変革をもたらしています。特に、ChatGPTのような大規模言語モデル(LLM)や、自律的に動作するエージェントAIの開発が加速する中で、その基盤となる計算能力の重要性はますます高まっています。この度、GMOインターネット株式会社が提供する高性能GPUクラウドサービス「GMO GPUクラウド」(https://gpucloud.gmo/)は、AI開発・研究の現場を強力に支援するため、最新の高性能GPU「NVIDIA HGX B300」をSlurmサービス専用プランに追加し、提供を開始しました。

AI開発の最前線を支える「NVIDIA HGX B300」とは?

AIモデルの学習や推論には、GPU(Graphics Processing Unit)と呼ばれる特殊な半導体が不可欠です。GPUは、大量の計算を並行して処理する能力に優れており、AIの複雑な計算を高速に実行できます。

今回「GMO GPUクラウド」に導入された「NVIDIA HGX B300」は、NVIDIAの最新世代GPUアーキテクチャ「Blackwell Ultra」を採用した高性能なGPUです。このGPUは、前世代のGPUと比較して、AIの学習(モデルを賢くするプロセス)と推論(学習済みのモデルを使って予測や判断を行うプロセス)の両方で大幅な性能向上を実現しています。特に、推論処理の高速化に貢献する「FP4」という新しいデータ形式にも対応しており、AIアプリケーションの応答速度向上に大きく寄与します。

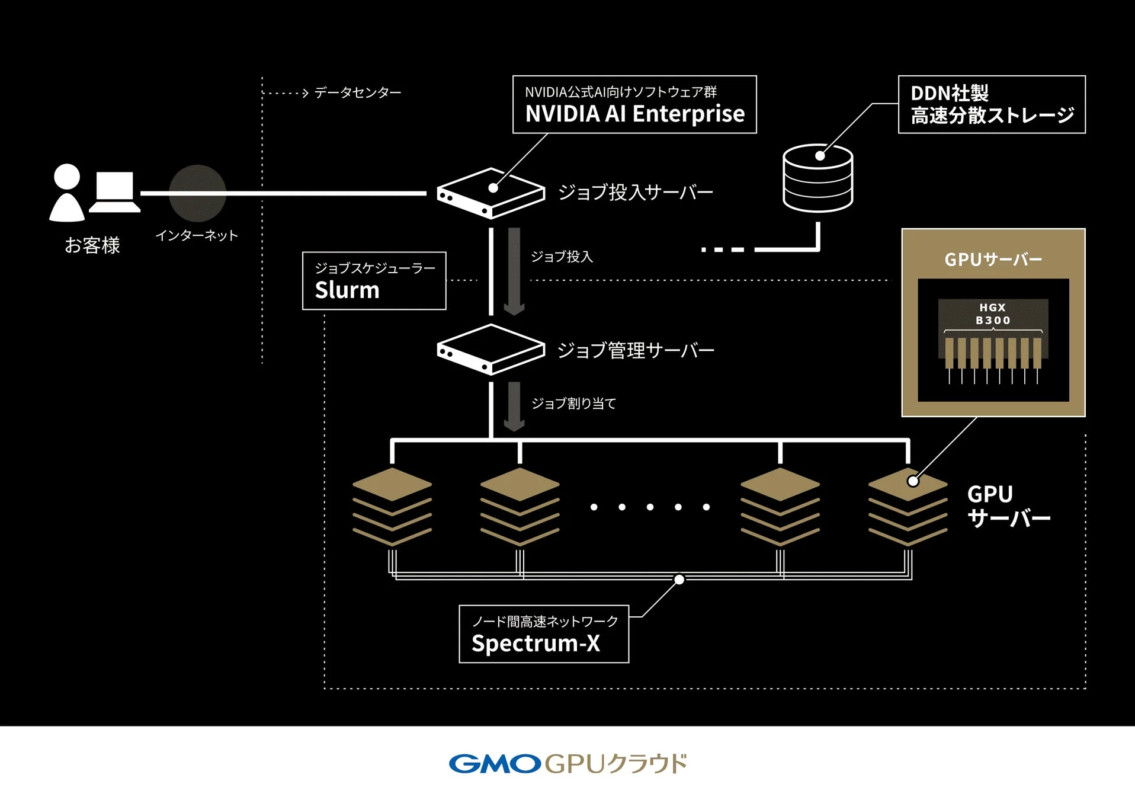

さらに、このシステムはAIワークロードに特化したイーサネットファブリック「NVIDIA Spectrum-X」(以下、Spectrum-X)を採用しています。Spectrum-Xは、GPU間のデータ通信を非常に高速かつ効率的に行うための技術で、複数のGPUを連携させて大規模なAIモデルを扱う際に、その真価を発揮します。これにより、データ転送のボトルネックを解消し、AI計算全体のパフォーマンスを最大限に引き出すことが可能になります。

「GMO GPUクラウド」は、これらの最新技術をNVIDIAが推奨する構成でインフラを構築しているため、AI開発者は最高の環境で研究や開発に集中できます。

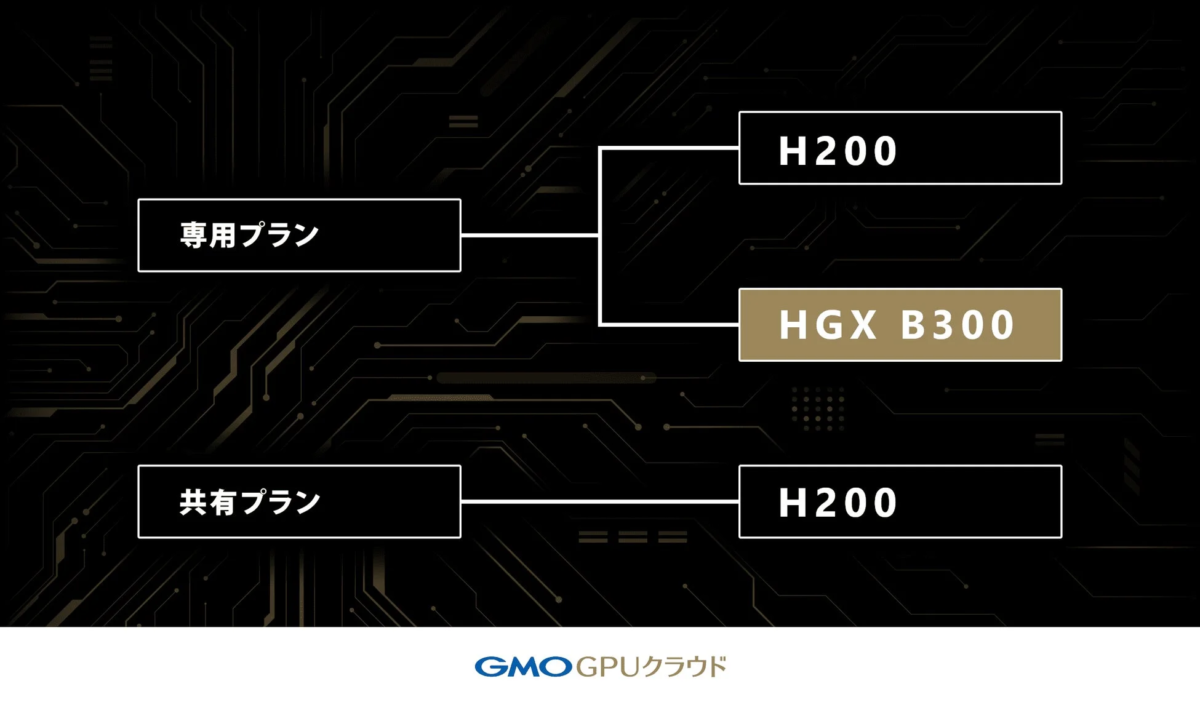

「GMO GPUクラウド」Slurmサービス専用プランの特長

AI開発における計算リソースの管理は、非常に複雑で専門的な知識が必要です。しかし、「GMO GPUクラウド」のSlurmサービス専用プランは、これらの課題を解決し、AI開発者が本来の業務に集中できる環境を提供します。

Slurmとは?

Slurm(スラーム)は、主に大規模な計算機クラスタ(複数のコンピューターを連携させたシステム)で利用される、ジョブスケジューラと呼ばれるソフトウェアです。AI開発では、GPUのような貴重な計算資源を効率的に管理し、複数のユーザーやタスクに適切に割り当てる必要があります。Slurmは、どのGPUをどのユーザーがどのくらいの時間使うか、といったことを自動で調整してくれるため、リソースの無駄をなくし、開発効率を向上させます。

マネージド環境の利点

通常、高性能なGPUクラスタを構築するには、ハードウェアの選定、OSやドライバのインストール、Slurmなどのソフトウェア設定、ネットワークの構築など、多岐にわたる専門知識と膨大な時間が必要です。しかし、「GMO GPUクラウド」のSlurmサービス専用プランは、これらの環境がすべてセットアップされた状態で提供されます。

-

インフラ構築不要: ユーザーは面倒な設定やチューニングを行うことなく、サービス利用開始後すぐにAI開発を始められます。

-

運用負荷の軽減: システムの監視やメンテナンスもGMOインターネットによって行われるため、運用にかかる手間とコストを削減できます。

-

最適化済みの環境: NVIDIA推奨構成を採用し、GPUソフトウェアスタックもインストール・最適化済みであるため、特別な知識がなくてもHGX B300の性能を最大限に引き出せます。

専有利用と安定した性能

この専用プランでは、GPUサーバーリソースを専有して利用できます。これは、他のユーザーとGPUを共有するのではなく、契約したリソースを自分たちだけで使えるということです。これにより、以下のようなメリットがあります。

-

混雑の影響を受けない: 他のユーザーの利用状況に左右されず、常に安定した高い性能でAI開発を進められます。

-

高いセキュリティ: 専有環境であるため、セキュリティ面での安心感も高まります。

高速分散ストレージ「DDN」の採用

AI開発、特に大規模なデータセットを扱う際には、高速なデータアクセスが不可欠です。「GMO GPUクラウド」は、DataDirect Networks, Inc.(DDN)の高速分散ストレージを採用しており、大量のデータを瞬時にGPUに供給できます。これにより、データの読み込み待ちによるGPUのアイドル時間を削減し、AI学習の効率を大幅に向上させます。

管理ダッシュボードと運用支援

GPUリソースの利用状況やジョブの進捗状況は、管理ダッシュボードで視覚的に確認できます。これにより、効率的なリソース管理と運用が可能となり、AI開発のサイクルを加速させます。

HGX B300とH200の性能比較:AI開発を加速する圧倒的な進化

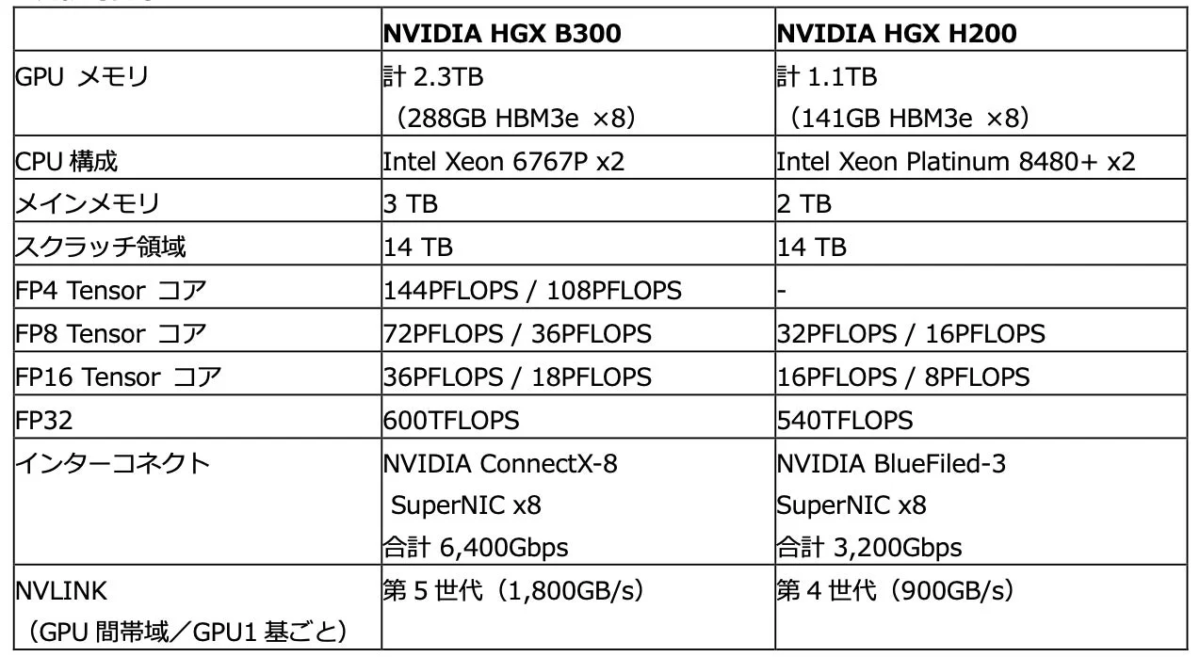

「GMO GPUクラウド」では、以前から高性能な「NVIDIA HGX H200」を提供していましたが、今回追加された「NVIDIA HGX B300」は、さらに高い性能を誇ります。以下の表で、主要なスペックを比較してみましょう。

GPUメモリの大幅増強

NVIDIA HGX B300は、GPUメモリが合計2.3TB(288GB HBM3e x8)と、H200の1.1TB(141GB HBM3e x8)から約2倍に増強されています。GPUメモリは、AIモデルのサイズや学習に使うデータ量に直結するため、メモリ容量の増強は、より大規模で複雑なAIモデルの学習を可能にし、一度に処理できるデータ量も増やすことができます。

Tensorコア性能の飛躍的向上

AI計算の核となるのが「Tensorコア」です。B300は、FP4、FP8、FP16、FP32といった様々な精度での計算に対応しており、特にFP4 Tensorコアでは144PFLOPS/108PFLOPSという驚異的な性能を発揮します。これは、H200にはなかった新しい精度であり、推論処理を格段に高速化します。

-

FP4 (Float Point 4): 非常に低い精度ですが、推論時に高いパフォーマンスを発揮します。モデルの精度を維持しつつ、計算を高速化できるため、リアルタイムAIアプリケーションなどで重要です。

-

PFLOPS (ペタフロップス): 1秒間に1000兆回の浮動小数点演算ができることを示す単位で、GPUの計算能力を示す指標です。

インターコネクトの高速化

B300は、NVIDIA ConnectX-8 SuperNICを8基搭載し、合計6,400Gbpsという高速なインターコネクト(GPU間の接続)を実現しています。H200の3,200Gbpsと比較して2倍の帯域幅です。また、GPU間の直接接続技術であるNVLINKも第5世代(1,800GB/s)に進化しており、GPU間のデータ転送速度が大幅に向上しています。これにより、複数のGPUを連携させた大規模な分散学習において、GPU間の通信遅延が最小限に抑えられ、AI学習の効率が向上します。

これらの進化は、大規模言語モデル(LLM)の高速学習やファインチューニング、コンピュータビジョンモデルの大規模データセットを用いた学習など、高い性能が求められるAI開発において、圧倒的なアドバンテージをもたらします。

「GMO GPUクラウド」が描く日本のAI産業の未来

AI技術の進化は止まることを知らず、それに伴いAIインフラの価値基準も変化しています。単に計算資源を確保するだけでなく、その「使いやすさ」と「性能を最大限に引き出す能力」が重要視されています。

GMOインターネットは、この潮流にいち早く対応してきました。2024年には、当時最新の「NVIDIA H200 GPU」を搭載したマネージドHPCクラスタサービスを提供開始し、構築不要のSlurm環境でAI開発を支援してきました。さらに2025年には、推論ニーズの高まりに応えるため、幅広い用途で利用可能なベアメタルサービスを開始しました。そして今回、学習用途としても高い性能を持つHGX B300をマネージドHPCクラスタサービスに追加することで、国内のAI産業の発展をさらに力強く後押しします。

GMOインターネットは、国内最速クラスで「NVIDIA HGX B300」のクラウドサービスを提供開始した実績を持ち(2025年12月時点)、今後もAI開発・研究の現場に最先端のAI計算基盤を提供し、日本の国際競争力強化に貢献していくとのことです。

-

GMO GPUクラウド「NVIDIA HGX B300」のクラウドサービスを国内最速クラスで提供開始(2025年12月時点)

今後も「GMO GPUクラウド」は、最新のAI計算基盤を迅速に提供し、お客様のニーズに応じた柔軟なクラウド環境を構築することで、日本のAI産業に不可欠な国産AIインフラとして、社会と産業のAIイノベーション創出に貢献していくことでしょう。

関連情報

-

GMO GPUクラウドについて: https://gpucloud.gmo/

-

GMOインターネット株式会社: https://internet.gmo/

-

サービスに関するお問い合わせ: https://gpucloud.gmo/form/

-

過去の関連リリース

-

2024年6月11日:GMOインターネットグループ、生成AI向けGPUクラウドサービスにNVIDIA Spectrum-Xを国内クラウド事業者として初採用

-

2024年11月22日:スパコンランキング TOP500 ランクインの「GMO GPU クラウド」を提供開始

-

2025年8月4日:GMO GPU クラウド「NVIDIA Blackwell Ultra GPU」を採⽤

-

その他関連リリースはこちら

-

まとめ

「GMO GPUクラウド」のSlurmサービス専用プランにおける「NVIDIA HGX B300」の提供開始は、AI開発者にとって画期的なニュースです。最新の高性能GPUと最適化されたマネージド環境が一体となることで、インフラ構築の手間から解放され、AIモデルの開発や研究に集中できる理想的な環境が実現します。日本のAI産業が世界をリードしていく上で、このような最先端の計算基盤の存在は不可欠であり、今後のAI技術のさらなる発展に大きく貢献することが期待されます。AI開発に携わる方々は、ぜひこの機会に「GMO GPUクラウド」の活用を検討してみてはいかがでしょうか。