AI開発の未来を拓く!IOWN APNが実現する遠隔分散型AIインフラの実用性能

近年、ChatGPTに代表される生成AIや大規模言語モデル(LLM)の急速な普及により、AI技術は私たちの生活やビジネスに不可欠な存在となりつつあります。これに伴い、AIを開発するための基盤、特に高性能なコンピューティング資源への需要が飛躍的に高まっています。

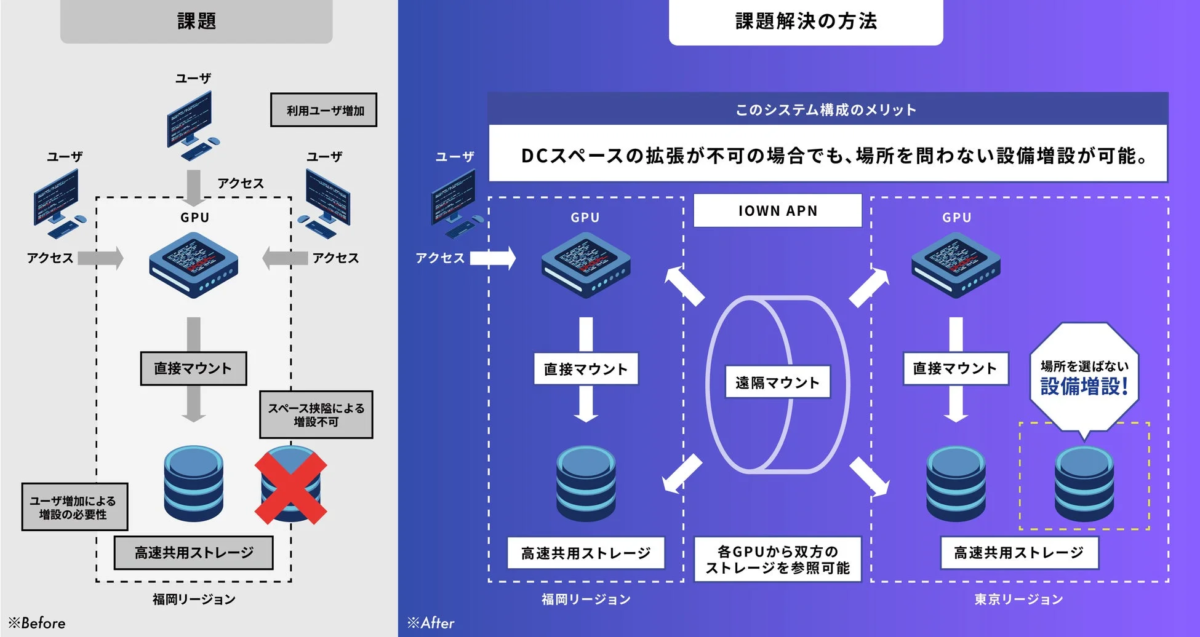

しかし、これまでのAI開発では、高性能なGPU(画像処理装置)と大容量のストレージ(データを保存する装置)を物理的に近い場所に設置することが必須とされてきました。この制約は、データセンターのスペース不足や、企業が自社のデータを安全に管理したいというニーズと衝突し、AI開発の大きな課題となっていました。

このような状況の中、GMOインターネット株式会社、NTT東日本株式会社、NTT西日本株式会社、株式会社QTnetの4社は、次世代の光ネットワーク技術である「IOWN (Innovative Optical and Wireless Network)」の「APN (All-Photonics Network)」を活用し、東京と福岡という約1,000km離れた場所にあるGPUとストレージを接続する遠隔分散型AIインフラの実証実験を完了しました。この実証は、遠隔地にあるAIインフラが、まるで隣接しているかのように実用的な性能を発揮することを確認し、AI開発の新たな可能性を切り開くものとして注目されています。

IOWN APNとは?AI開発にもたらす革新の光ネットワーク

IOWN APNとは、NTTグループが提唱する次世代の通信インフラ「IOWN」の中核をなす技術の一つです。簡単に言えば、通信ネットワークのあらゆる部分を光で構成することで、従来の電気信号による通信では実現できなかった「超高速」「大容量」「低遅延」を可能にするネットワーク技術です。

AI開発、特に大規模なAIモデルの学習では、膨大なデータをGPUに送り込み、処理結果を受け取るというデータ転送が頻繁に発生します。従来のネットワークでは、このデータ転送速度や遅延がボトルネックとなり、AI学習の効率が低下することがありました。しかし、IOWN APNの登場により、まるで目の前にあるかのように遠隔地のGPUやストレージにアクセスできるようになるため、地理的な距離がAI開発の障壁となることがなくなります。

AI開発基盤の現状と遠隔分散の必要性

AI開発、特に深層学習と呼ばれる技術では、大量のデータを高速で処理するために、高性能なGPUが不可欠です。そして、そのGPUが参照する学習データは、大容量のストレージに保存されます。これまでの常識では、GPUとストレージは、ネットワーク遅延を最小限に抑えるため、同じデータセンター内や、物理的に極めて近い場所に配置することが求められていました。

しかし、この物理的な制約は、いくつかの課題を生み出していました。

-

データセンターのスペース制約: 高性能なGPUサーバーや大容量ストレージは、設置に広いスペースを必要とします。データセンターのスペースには限りがあり、増設が難しい場合があります。

-

データ管理のニーズ: 企業によっては、セキュリティやコンプライアンス(法令順守)の観点から、データを自社の拠点内で管理したいという強いニーズがあります。クラウド上にデータを置くことに抵抗がある場合、利用できるAI開発基盤の選択肢が限られてしまいます。

-

リソースの柔軟な活用: 特定の場所にGPUとストレージが固定されると、必要に応じてリソースを柔軟に増減させることが難しくなります。

これらの課題を解決し、地理的な制約を超えてGPUとストレージを分散配置できる「遠隔分散型AI開発基盤」の実現が、現在のAI開発業界で強く求められています。IOWN APNは、まさにこのニーズに応えるための鍵となる技術として期待されていました。

東京-福岡間、約1,000kmでの実証実験の全貌

今回の実証実験は、大きく2つのフェーズに分けて行われました。

事前実証(Phase1):疑似遠隔環境での性能テスト

本実証に先立ち、2025年7月には、福岡のデータセンター内に「OTN Anywhere」という遅延調整装置を設置し、東京-福岡間(約1,000km)に相当する15ミリ秒の疑似遅延環境を構築しました。この環境下で、GMOインターネットが提供する「GMO GPUクラウド」を利用し、画像認識タスク(ResNet)と言語学習タスク(Llama2 70B)の性能テストを実施しました。

結果として、画像認識タスクのベンチマークスコアの低下は約12%程度に留まり、これは商用利用が可能な範囲であると判断されました。この事前実証の成功が、実際の長距離回線を用いた本実証へと進む大きな一歩となりました。

- 事前実証の詳細については、以下の技術レポートで公開されています。

技術レポート

本実証(Phase2):IOWN APN実回線での性能検証

2025年11月から2026年2月にかけて実施された本実証では、実際のIOWN APN実回線が使用されました。接続区間は、GMOインターネットグループの第2本社がある東京都渋谷区と、QTnetのデータセンターがある福岡県福岡市です。この約1,000kmの区間を100GbEのIOWN APN回線で接続しました。

福岡側には高性能なGPUサーバー「NVIDIA HGX H100」を、渋谷側には高速ストレージ「DDN AI400X2」をそれぞれ配置し、遠隔ストレージを利用した際のAI学習性能が詳細に測定されました。

検証内容は、以下の2つのAIワークロードです。

- 大規模言語モデル(LLM)処理タスク(Llama2 70B): 自然言語処理の分野で注目される大規模なAIモデルの学習にかかる時間を測定しました。LLMの学習は、主にGPU内部での複雑な演算処理が主体となるため、データ転送の頻度が比較的少ない特性があります。

- 画像分類タスク(ResNet): 画像の内容を識別するAIモデルの学習にかかる時間を測定しました。このタスクでは、大量の画像データをストレージから読み込む頻度が高く、データ転送性能が学習時間に大きく影響する特性があります。

実証結果が示す驚くべき成果:遠隔環境でも「ほぼ遜色なし」

実証実験の結果は、AI開発における物理的距離の常識を覆すものでした。IOWN APNを経由した東京-福岡間の遠隔分散環境においても、GPUとストレージが同一データセンター内にあるローカル環境と「遜色ない」パフォーマンスを発揮することが確認されたのです。

大規模言語モデル(Llama2 70B)学習タスク

-

ローカル環境: 24.87分

-

遠隔環境(IOWN APN経由): 24.99分

この結果から、LLM学習のような演算処理が主体となるタスクでは、遠隔環境であっても遅延の影響は極めて限定的であり、その差は約0.5%に過ぎないことが実証されました。これは、遠隔地にあるGPUとストレージを接続しても、まるで隣り合っているかのように高速なAI学習が可能であることを意味します。

画像分類(ResNet)タスク

-

ローカル環境: 13.72分

-

遠隔環境(IOWN APN経由): 14.38分

画像分類タスクのようにデータ読み込みが頻繁に発生するタスクにおいても、適切なデータ整形(例えば、学習データをGPUが効率的に読み込める形式に事前に処理しておくことなど)を行うことで、遠隔環境でも実用レベルでの処理が可能であることが確認されました。これにより、データ転送の多いタスクでも、工夫次第で遠隔分散環境が十分に機能することが示されました。

これらの詳細なテスト結果は、以下の別紙で確認できます。

『IOWN APN』を活用した遠隔分散型AIインフラにおけるGPU・ストレージ間接続性能テストの詳細と結果

本実証がもたらすAI開発の変革と期待される活用事例

今回の実証の成功は、AI開発における「計算資源(GPU)とデータ(ストレージ)の物理的分離」という長年の課題を解決する、まさに大きな転機となります。これまでは、AI学習に必要なデータは、クラウド事業者のデータセンターに転送したり、複製したりすることが一般的でした。しかし、この方法では、データ転送の時間やコストがかかるだけでなく、データの重複管理による手間やセキュリティリスクも伴いました。

本実証が示したのは、「データは動かさず、計算資源が遠隔からデータへアクセスする」という新たなAI開発モデルです。これは、特にデータ主権やセキュリティ要件が厳しい分野において、非常に重要な選択肢となります。

データ主権とソブリンクラウドの実現

「データ主権」とは、企業や組織が自らのデータを完全に管理し、そのデータがどこに保存され、どのように扱われるかをコントロールできる権利のことです。金融、医療、防衛、行政といった分野では、個人情報や機密情報を含むデータを外部に預けることに厳しい規制や懸念があります。

今回のIOWN APNによる遠隔分散型AIインフラは、データを自社施設や自組織の管理下に置いたまま、遠隔にある国内クラウドの高性能GPUリソースを活用できる可能性を示しました。これは、データを国内に留め、自国の法律や規制の下で管理できる「ソブリンクラウド」の実現に大きく貢献するものと期待されます。ソブリンクラウドは、国家レベルでのデータセキュリティやデジタル主権を確保する上で非常に重要な概念です。

期待される具体的な活用事例

この技術が実用化されることで、以下のような様々な活用が期待されます。

-

大規模学習データ、または機密データを保持した状態でのAI学習: 企業が自社で厳重に管理している機密性の高いデータを外部に移動させることなく、遠隔地の高性能クラウドGPUでAIモデルの学習を実行できるようになります。これにより、セキュリティリスクを大幅に低減しながら、最新のAI技術を活用できます。

-

既存のオンプレミス環境とのハイブリッド活用: すでに自社でストレージや一部のGPUリソースを持っている企業が、不足する高性能GPUリソースだけを遠隔地のクラウドから調達し、既存資産とクラウドを組み合わせた柔軟なAI開発環境を構築できます。これにより、投資効率を高めつつ、AI開発を加速できます。

-

地方分散配置によるBCP(事業継続計画)対応: 計算資源とストレージを地理的に分散して配置することで、万が一、災害やシステム障害が発生した場合でも、AI処理の継続性を確保できる高可用性環境を構築できます。これは、AIを活用した重要なビジネスプロセスにおいて、事業中断のリスクを最小限に抑える上で非常に有効です。

ただし、実際の適用にあたっては、GPUとストレージ間の距離やネットワーク構成など、個別の条件によって性能が変動する可能性があるため、それぞれのユースケースごとに適用可能かどうかを慎重に検討する必要があります。

今後の展望:IOWN APNがAI基盤のバックボーンへ

今回の実証は、IOWN APNが単なる高速な通信回線に留まらず、AIやクラウド基盤を支える社会インフラへと発展していく道筋を明確に示しました。

4社は今後、NTT東日本・NTT西日本が提供する「All-Photonics Connect powered by IOWN」の普及と、「GMO GPUクラウド」をはじめとするクラウドサービス事業者、そしてQTnetのような地方データセンターとの連携を一層深めていく方針です。これにより、IOWN APNがAI基盤のバックボーンとして、社会全体に広く実装されていくことを目指しています。

AI技術の進化は止まることがありません。IOWN APNのような革新的なインフラ技術が、その進化をさらに加速させ、私たちの社会に新たな価値を生み出すことが期待されます。遠隔地の壁を越えたAI開発環境の実現は、より多くの企業や研究者がAIを活用し、イノベーションを起こすための強力な土台となるでしょう。