ロボットアームが透明・光沢物体を高速かつ正確に把持する画期的な新技術「HEAPGrasp」とは?

生産現場の自動化は、効率化とコスト削減の鍵を握っています。しかし、透明な容器や光沢のある包装材など、特定の物体はロボットアームによる把持が非常に困難でした。これらの物体は、光の反射や透過によってロボットが形状を正確に認識できないため、これまで多くの工程で人の手作業に頼らざるを得ない状況が続いていました。

このような課題に対し、東京理科大学の研究グループが画期的な新技術「HEAPGrasp」を開発しました。この技術は、透明・光沢物体を高速かつ正確に把持することを可能にし、生産現場の自動化を大きく前進させ、作業時間の短縮と生産性向上に貢献すると期待されています。

なぜ透明・光沢物体の把持は難しかったのか?

ロボットアームが物体を把持するためには、まずその物体の「形」や「位置」を正確に知る必要があります。この情報を得るために使われるのが「3次元計測」という技術です。

従来の3次元計測の課題

従来の3次元計測技術は、深度センサーなどを用いて物体の奥行き情報を取得します。しかし、透明な物体(ガラス瓶やプラスチック容器など)や光沢のある物体(金属部品やビニール包装など)は、光の性質上、以下のような問題がありました。

-

透明物体: 光が物体を透過してしまうため、深度センサーが物体の表面を正確に捉えられず、背景と区別がつきにくい。

-

光沢物体: 物体表面で光が強く反射するため、センサーにノイズが生じたり、実際の形状とは異なる情報が取得されたりする。

これらの問題により、ロボットは物体の正確な3次元情報を得ることができず、結果として安定した把持が困難でした。また、物体の姿勢や位置をより正確に把握しようとすると、複数の角度からカメラで撮影する必要があり、カメラの移動に時間がかかり、作業全体の効率が低下するという別の課題も抱えていました。

「HEAPGrasp」が実現する高速・高精度な把持の仕組み

東京理科大学の荒井 翔悟准教授とケニス 銀河氏の研究グループは、これらの課題を解決するため、複数の先進技術を組み合わせた「HEAPGrasp」を開発しました。

1. 光学特性に左右されない形状推定

HEAPGraspでは、従来の深度センサーが苦手とする透明・光沢物体に対して、以下の二つの技術を組み合わせることで、形状を正確に推定します。

-

RGB画像のセマンティックセグメンテーション: これは、一般的なカラー画像(RGB画像)の中から、対象物(例えば「コップ」や「ボトル」)の領域をピクセル単位で正確に切り出す技術です。光の反射や透過の影響を受けにくいカラー画像を用いることで、物体の輪郭を安定して認識できます。

-

Shape from Silhouette(シェイプ・フロム・シルエット): 複数方向から撮影した物体のシルエット(影絵)情報を使って、その物体の3次元形状を復元する技術です。セマンティックセグメンテーションで得られた正確な輪郭情報を基に、物体の外形を安定して復元することができます。

これらの技術を組み合わせることで、透明・光沢物体の形状を高い精度で推定することが可能になりました。

2. 効率的なカメラ移動と把持計画

Shape from Silhouetteは精度を高めるために複数の視点からの撮影が必要ですが、これはカメラの移動時間が増えるという課題があります。HEAPGraspでは、この課題を解決するために「コスト関数」という考え方を導入し、カメラの撮影位置と移動経路を最適化しました。

「コスト関数」とは、3次元計測の「精度向上」とカメラの「移動距離短縮」という二つの要素を同時に考慮し、最もバランスの取れた動きをロボットに指示するための計算式です。これにより、必要最小限のカメラ移動で十分な精度を確保できるようになり、作業全体の時間を大幅に短縮することに成功しました。

この最適化された撮影位置と移動経路に基づき、ロボットは物体を安定してつかむための「把持計画」を立て、実際に物体を把持します。

驚くべき研究成果:把持成功率96.0%と大幅な時間短縮

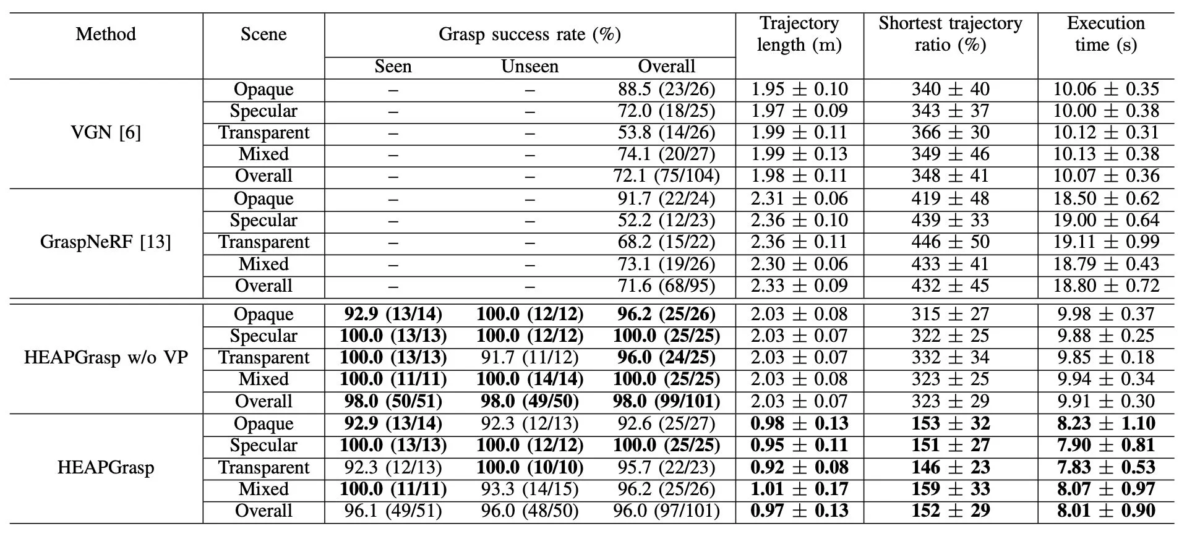

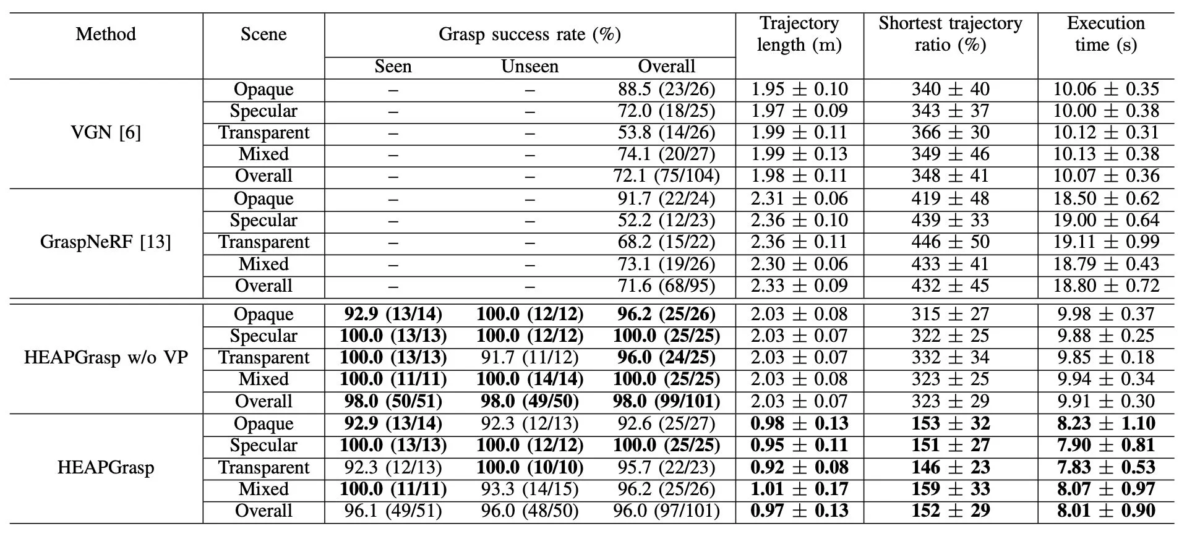

研究グループは、開発したHEAPGraspを実機ロボットで検証しました。その結果は、この技術の画期的な性能を明確に示しています。

圧倒的な把持成功率

従来の手法(VGN、GraspNeRF)と比較して、HEAPGraspは以下の点で優れた結果を出しました。

| 手法名 | 不透明物体 | 光沢物体 | 透明物体 | 未知物体 (全体) |

|---|---|---|---|---|

| VGN | 88.5% | 72.0% | 53.8% | 72.1% |

| GraspNeRF | 91.7% | 52.2% | 68.2% | 71.6% |

| HEAPGrasp | 92.6% | 100.0% | 95.7% | 96.0% |

この表が示すように、従来のVGNやGraspNeRFでは光沢物体や透明物体の把持成功率が大きく低下していましたが、HEAPGraspは、不透明物体、光沢物体、透明物体のいずれにおいても92.6%以上の高い把持成功率を達成しました。さらに、学習時に使用していない「未知の物体」に対しても96.0%という高い把持成功率を示しており、その汎用性の高さが証明されました。

作業時間の大幅な短縮

HEAPGraspは、把持の精度だけでなく、効率性においても優れた結果を出しています。

-

カメラ移動距離: 従来法と比較して、カメラの移動距離を52%削減 (0.97 m)。

-

ハンドリング全体の実行時間: 従来法と比較して、ハンドリング全体の実行時間を19%短縮 (8.01秒)。

これは、最適化された撮影位置と移動経路を決定するコスト関数の効果が明確に表れた結果です。高速かつ正確な把持を実現することで、生産現場で求められる作業時間(タクト)を短縮し、システム全体の効率を大きく向上させることが可能になりました。

生産現場の未来を変える「HEAPGrasp」の可能性

この研究成果は、これまで自動化が困難だった工程にロボット技術を導入する道を切り開きます。

1. 生産現場のボトルネック解消

荒井准教授は、「製造や物流の現場では、透明トレーや光沢袋など自動化が難しい対象が工程に残り、人の手に頼るボトルネックとなっています」とコメントしています。HEAPGraspは、まさにこれらのボトルネックを解消し、人手に依存していた工程のロボット化を推進します。これにより、人手不足の解消や、危険な作業からの解放にも繋がるでしょう。

2. 高い汎用性と導入の容易さ

HEAPGraspは、事前調整を削減した設計になっているため、既存の設備への導入や多品種への対応が容易になります。これにより、様々な製品を扱う生産ラインや、頻繁に製品が変わる現場でも、柔軟にロボットシステムを導入・運用できるようになります。

3. さらなる自動化と効率化への展望

荒井准教授は、「将来的には、段取り換えや対象追加が多い現場でも、運用条件に合わせて最適な動作を生成しやすいロボットシステムの実現を目指します」と、今後の展望を語っています。この技術は、単一の作業を自動化するだけでなく、より複雑で変化の多い環境でのロボットの自律的な判断と行動を可能にし、さらなる生産性向上に貢献する可能性を秘めています。

用語解説

AI初心者の方にも分かりやすいように、この記事で出てきた専門用語を解説します。

-

3次元計測 (さんじげんけいそく): カメラやセンサーを使って、物体の「縦・横・奥行き」の情報を取得する技術です。ロボットが物体を正確につかむために、その物体の形やどこにあるかを把握する基礎となります。

-

把持計画 (はじけいかく): 3次元計測で得られた物体の情報に基づいて、ロボットがその物体を最も安定して、かつ安全につかむための「つかみ方」や「つかむ位置」を考えるプロセスです。

-

ハンドアイ構成 (ハンドアイこうせい): ロボットの「手先」(ハンド)にカメラを取り付けて、そのカメラの目で見た情報を使ってロボットの動きを制御する仕組みです。人間が手元を見ながら作業するのに似ています。

-

セマンティックセグメンテーション: 画像の中の「これはコップ」「これは背景」といったように、ピクセル一つ一つが何であるかを分類する画像認識の技術です。これにより、ロボットは画像の中から対象の物体だけを正確に切り出して認識できます。

-

Shape from Silhouette (シェイプ・フロム・シルエット): 複数の方向から撮影した物体の「シルエット」(影絵のようなもの)の画像を使って、その物体の立体的な形を推定する技術です。光沢や透明な物体の外形を安定して捉えるのに役立ちます。

論文情報

本研究成果は、国際学術誌「IEEE ROBOTICS AND AUTOMATION LETTERS」にオンライン掲載されました。また、ロボティクス分野のトップカンファレンスである「2026 IEEE International Conference on Robotics & Automation (ICRA 2026)」でも発表が予定されており、世界的な注目を集めています。

-

雑誌名: IEEE ROBOTICS AND AUTOMATION LETTERS

-

論文タイトル: HEAPGrasp: Hand-Eye Active Perception to Grasp Objects with Diverse Optical Properties

-

著者: Ginga Kennis and Shogo Arai

より詳細な情報については、東京理科大学の公式ウェブページもご参照ください。