ローカルLLM/RAGの課題を解決!GDEPソリューションズがマルチGPU最適化基盤「G-RAGrid」と自律型AIエージェント「G-RAGent」を発表

AI技術の進化は目覚ましく、特に大規模言語モデル(LLM)の登場は、ビジネスのあり方を大きく変えようとしています。多くの企業がAIの導入を検討する中で、自社のデータを使った安全で効率的なAI活用は重要な課題となっています。この課題に対し、高性能GPUサーバーやAIソリューションを提供するGDEPソリューションズ株式会社は、画期的な新製品を発表しました。

同社は、現在開発中の新製品として、マルチGPU最適化基盤「G-RAGrid(ジー・ラグリッド)」およびローカルAIエージェント「G-RAGent(ジー・ラジェント)」の開発を表明しました。これらは、既存のローカルLLM/RAGソリューション「G-RAGon」と組み合わせることで、「構築」から「運用」まで一貫して企業のAI活用を支援するソリューション群として展開されます。

AI初心者のための基礎知識:LLMとRAG、そしてローカルAIの重要性

まず、AI初心者の方にも分かりやすく、今回の発表の背景となる「LLM」「RAG」「ローカルAI」といったキーワードについて説明しましょう。

LLM(大規模言語モデル)とは?

LLMとは「Large Language Model」の略で、大量のテキストデータを学習することで、人間のような自然な文章を理解し、生成できるAIモデルのことです。私たちが普段使っている言葉を理解し、質問に答えたり、文章を作成したり、要約したりといった高度な言語処理が可能です。しかし、学習データが古かったり、特定の分野に特化していなかったりすると、不正確な情報(ハルシネーション)を生成するリスクがあります。

RAG(検索拡張生成)とは?

RAGとは「Retrieval-Augmented Generation」の略で、LLMの弱点を補うための技術です。RAGは、ユーザーからの質問に対し、まず社内文書やデータベースなどの「外部情報源」から関連性の高い情報を検索し、その検索結果をLLMに与えて回答を生成させる仕組みです。これにより、LLMが学習していない最新の情報や、企業独自の専門知識に基づいた、より正確で信頼性の高い回答を得ることができます。ハルシネーションのリスクを減らし、情報の正確性を高める上で非常に重要な技術と言えるでしょう。

ローカルAIの重要性:セキュリティとカスタマイズ性

「ローカルAI」とは、インターネット上のクラウドサービスではなく、自社のサーバーやPCなど、管理された環境内でAIを動かすことを指します。これにより、企業は機密性の高いデータを外部に漏らすことなくAIを活用でき、セキュリティを大幅に向上させることが可能です。また、自社の環境に合わせてAIを細かくカスタマイズできるため、より業務に最適化されたAIシステムを構築できます。

GDEPソリューションズが提供するLLM/RAGソリューションは、このローカル環境でのAI活用に特化しており、企業のデータセキュリティとAIの性能を両立させることを目指しています。

GDEPソリューションズが提供する「LLM/RAGシリーズ」の全貌

GDEPソリューションズの「LLM/RAGシリーズ」は、既存の「G-RAGon」に加えて、今回発表された「G-RAGrid」と「G-RAGent」の3製品で構成されます。これらの製品が連携することで、ローカルLLM/RAGの導入から運用まで、企業が抱える様々な課題を解決し、AI活用を強力に推進します。

既存製品「G-RAGon」:高精度チャットボット構築の要

G-RAGonは、高精度なチャットボットを構築するためのRAG運用支援ツールです。企業内の膨大な資料やドキュメントから必要な情報を効率的に抽出し、LLMがより正確な回答を生成できるようにサポートします。特に、RAGの回答精度を改善し、運用を支援する機能が充実しており、企業独自のデータに基づいた質の高いチャットボットを実現します。

G-RAGonの特長としては、独自チャンキングによる高精度化や、Excel方眼紙への対応、PDF解析の強化などが挙げられます。これにより、様々な形式の社内資料をAIが適切に理解し、活用できるようになり、より実用的なAIチャットボットの構築が可能になります。

新製品「G-RAGrid」:マルチGPUを最大限に活かす高効率LLM実行環境

ローカル環境でLLMやRAGを運用する際、特に複数のAIモデルを同時に動かしたり、多くのユーザーが利用したりする場合には、高性能なGPU(Graphics Processing Unit)が必要になります。しかし、従来のシステムでは、GPU資源が効率的に使われず、性能を最大限に引き出せないという課題がありました。また、部署ごとにデータを分離して管理することも難しいケースがありました。

G-RAGridは、これらの課題を解決するために開発された、マルチGPU環境を最適化する基盤です。複数のGPUが搭載されたサーバーで、GPUの力を無駄なく使うための仕組みを提供します。

G-RAGridの主な特長とメリット

-

高効率なLLM実行環境:

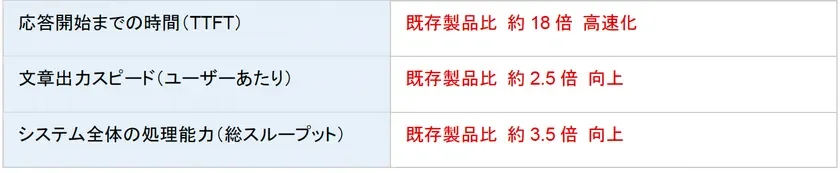

G-RAGridは、開発や検証の段階では「Ollama」というツールを使い、実際の運用段階では「vLLM」という高速な推論フレームワークをロードバランシング(複数のGPUに処理を分散させる技術)で運用します。これにより、既存製品と比較して圧倒的なパフォーマンスを実現します。例えば、ベンチマーク結果では、応答開始までの時間が約18倍高速化し、ユーザー一人あたりの文章出力スピードは約2.5倍向上、システム全体の処理能力(総スループット)は約3.5倍向上したことが報告されています。これは、AIの応答速度が劇的に向上し、より多くのユーザーがストレスなくAIを利用できることを意味します。

-

Blackwell世代GPUへの対応と並列処理:

NVIDIAの最新GPUであるBlackwell世代の大容量メモリを最大限に活用し、LLMに対する複数の処理を効率良く並列に実行できます。これにより、同時に利用するユーザーが増えても、安定した性能を維持することが可能です。企業内の部署やチームがそれぞれAIを活用する際にも、個別のワークスペースを完全に分離して管理できるため、データセキュリティも確保されます。 -

シームレスなスケールアップ:

AIの利用が増え、より多くの処理能力が必要になった場合でも、G-RAGridはロードバランス機能によってGPUを追加するだけで、システムを停止することなく簡単に性能を向上させることができます。小規模な導入から始めて、全社的なAI展開へと段階的に拡張できる柔軟性も大きな魅力です。

このように、G-RAGridは、企業のAI活用において、高性能なGPU資源を最大限に引き出し、効率的かつセキュアなAI運用を可能にする画期的な基盤と言えるでしょう。

新製品「G-RAGent」:自律的に業務を遂行するローカルAIエージェント

AIエージェントとは、人間からの指示(自然言語)を理解し、AIが自ら考えて複数のツールやシステムを連携させ、目標達成に向けて一連のタスクを自律的に実行するAIのことです。例えば、「この資料を要約して、その内容を元に報告書を作成し、関連部署にメールで送って」といった指示を出すだけで、AIがそれぞれのタスクを自動で実行してくれます。

G-RAGentは、このような自律的な業務遂行を可能にするローカルAIエージェントとして開発が進められています。最大の特長は、社内の閉じた環境(ローカル環境)で動作するため、機密性の高い情報を扱う業務でも安心して利用できる点です。

G-RAGentの主な機能と期待される活用例

-

自然言語による指示:

ユーザーは、普段使っている言葉でAIに指示を出すだけで、複雑な業務を任せることができます。プログラミングの知識がなくても、誰でも簡単にAIを活用できるようになります。 -

LLMの思考能力を活用:

G-RAGentはLLMの高度な思考能力を活用し、単なる情報の検索だけでなく、状況判断や問題解決、計画立案といった、より複雑なタスクをこなすことを目指しています。 -

社内データの参照と活用:

社内のデータベースやドキュメントを参照しながら、必要な情報を収集・分析し、業務に反映させます。これにより、企業独自の知識やノウハウに基づいた、質の高いアウトプットが期待できます。 -

具体的な業務例:

-

Office系ドキュメントの生成:会議の議事録作成、報告書のドラフト作成、プレゼンテーション資料の骨子作成など。

-

蓄積された社内資料の解説や要約:膨大な社内マニュアルや過去のプロジェクト資料から、必要な情報を抽出し、分かりやすく要約・解説する。

-

情報検索と分析:特定のテーマに関する社内情報を横断的に検索し、分析結果をレポートとしてまとめる。

-

G-RAGentは、これらの機能を安全なローカル環境で実行することで、企業の生産性向上と業務効率化に大きく貢献することが期待されます。研究開発中の段階ですが、その可能性は非常に大きいと言えるでしょう。

「AI・人工知能EXPO【春】2026」でG-RAGridとG-RAGentを体験

GDEPソリューションズは、今回発表された新製品群を、2026年4月15日(水)から17日(金)まで東京ビッグサイトで開催される「AI・人工知能EXPO【春】2026」に出展する予定です。小間番号は21-21です。この機会に、最先端のローカルLLM/RAGソリューションを直接体験し、その性能や機能について詳しく知ることができるでしょう。

GDEPソリューションズ株式会社とは?AI/HPC分野のリーディングカンパニー

GDEPソリューションズ株式会社は、NVIDIA Partner Network(NPN)認定のソリューションプロバイダとして、GPUコンピューティング分野で豊富な実績と高い技術力を持つ企業です。NVIDIA製GPUを活用した高性能コンピューティング環境の提供を中心に、AI・データサイエンス、HPC(高性能計算)、CG・映像制作など、幅広い分野で顧客の課題解決を支援しています。

生成AIやLLMの開発・運用環境、CAEシミュレーション、データ解析といった多岐にわたるソリューションを提供しており、今回の新製品群の発表も、同社の技術力の高さを裏付けるものです。

-

GDEPソリューションズ株式会社 公式サイト:https://gdep-sol.co.jp/

-

LLM/RAGシリーズ 製品ページ:https://gdep-sol.co.jp/gpu-solution/llm-rag-series/

まとめ:企業のAI活用を加速するGDEPソリューションズの挑戦

GDEPソリューションズが発表した「G-RAGrid」と「G-RAGent」は、既存の「G-RAGon」と連携することで、企業のローカルLLM/RAG活用を「構築」から「運用」まで一貫して支援する強力なソリューション群となります。

これらの新製品は、GPU資源の非効率な利用やデータ分離の課題を解決し、安全なローカル環境で自律的なAIエージェントによる業務効率化を促進します。AI初心者の企業でも、これらのソリューションを活用することで、セキュリティを確保しつつ、AIの恩恵を最大限に享受できるようになるでしょう。GDEPソリューションズの挑戦は、企業のデジタルトランスフォーメーションをさらに加速させることでしょう。